Feature Engineering: Daten in Wert verwandeln

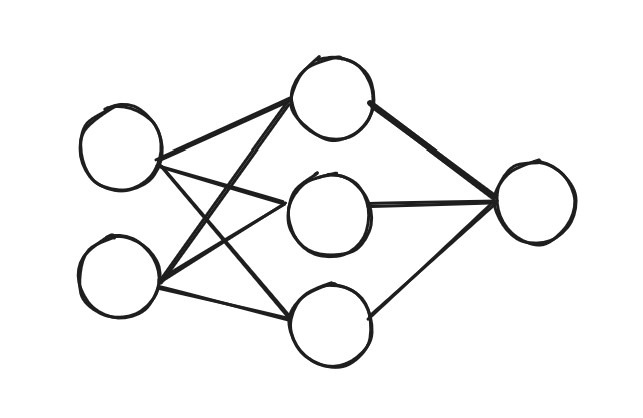

Feature Engineering ist ein essenzieller Prozess in der

Datenanalyse und im Machine Learning (Maschinellen Lernen). Dabei geht darum, aus Rohdaten neue Variablen oder Merkmale zu erstellen, die die Leistung von Modellen verbessern. Daten aufzubereiten und zu transformieren ist essenziell für erfolgreiche Vorhersagen und Analysen

Wie funktioniert Feature Engineering?

Der Prozess als Teil des Data Preprocessing (Daten-Vorverarbeitung) beginnt mit einer gründlichen Analyse der Rohdaten. Zunächst identifiziert man missing values (deutsch: fehlende Werte) und Anomalien wie Outliers (deutsch: Ausreißer). Anschließend erfolgt die Transformation und Erstellung neuer Features (deutsch: Merkmale). Im Folgenden findet ihr die wichtigsten Schritte:

- Data Preparation/ Datenbereinigung: Identifikation und Behandlung von fehlenden oder fehlerhaften Daten. Beispielsweise kann man Missing Values/ fehlende Werte durch Durchschnittswerte ersetzen oder unlogische Datenpunkte (zur Not) entfernen.

- Data Transformation: Man bringt Rohdaten in eine besser lesbare und modellierbare Form. Methoden wie Normalization (deutsch: Normalisierung) (Umwandlung von Daten in einen bestimmten Wertebereich) oder One-Hot-Encoding (Umwandlung von Kategorien in binäre Variablen) kommen hier zum Einsatz.

- Feature Extraction/ Feature Creation: Im Machine Learning (deutsch: Maschinelles Lernen) generiert man neue Variablen aus bestehenden Daten. In diesem Rahmen kann beispielsweise aus einem Datum ein Merkmal wie „Wochentag“ oder „Quartal“ extrahiert werden.

- Feature Selection: Nicht alle Merkmale sind gleichermaßen relevant. Statistische Tests und Algorithmen wie die Lasso-Regression helfen, die wichtigsten Merkmale zu identifizieren und irrelevante zu entfernen.

Praktische Beispiele

Ein anschauliches Beispiel für Feature Engineering findet sich im E-Commerce. Hier kann man Transaktionsdaten verwenden, um neue Merkmale wie die durchschnittliche Kaufhäufigkeit eines Kunden oder die Beliebtheit bestimmter Produkte zu erstellen. Diese Variablen helfen, personalisierte Empfehlungen zu erstellen und das Kundenerlebnis zu verbessern.

Ein weiteres Beispiel: Im Gesundheitswesen kann man außerdem aus Patientendaten Merkmale wie den BMI (Body Mass Index) oder den Durchschnittsblutdruck berechnen. Diese Features/ Merkmale verbessern insbesondere die Genauigkeit von Vorhersagemodellen zur Krankheitsprävention.

Herausforderungen und Best Practices

Feature Engineering ist zeitaufwendig und erfordert ein tiefes Verständnis der Daten. Die größte Herausforderung liegt dabei darin, relevante Features/ Merkmale zu identifizieren, die tatsächlich einen Mehrwert für das Modell bieten. Für die Datenvorverarbeitung kann man Tools wie

scikit-learn und

pandas nutzen.

Durch effektives Feature Engineering schöpft man das Potenzial von Daten vollständig aus. Dies führt zu besseren Predictions (deutsch: Vorhersagen) und fundierteren Entscheidungen.

Wenn dich der Artikel interessiert hat, schau dir doch unsere anderen Artikel an, z.B. zum Thema

PCA & Co: Techiken zur Dimensionality Reduction.